7 min to read

[수리통계학] 1. 확률분포

Mathematical Statistics

[수리통계학] 1. 확률변수

목차

- 확률분포

- 다차원 확률변수의 확률분포

- 이산형 확률분포

- 연속형 확률분포

- 대표적인 표본분포

- 중심극한정리

- 극한분포와 확률수렴

- 추정

- 검정

- 추정량의 비교

- 검정의 비교

- 분산분석과 회귀분석

- 베이지안 추론

1.1. 확률의 정의

표본공간 (Sample Space)

- 실험, 자연현상, 사회현상에서 관측가능한 모든 결과들의 집합

사건 (Event)

- 표본공간의 부분집합에서 특정 결과들의 집합

확률의 공리 (Axioms of Probability)

- 각 사건 A의 확률을 P(A)라고 할 때,

1) $P(A)\geq0$

2) 표본공간 S에 대해 $P(S)=1$

3) 사건 $A_i, A_j$에 대해 $A_i\cap A_j=\emptyset (i\neq j)$이면 $P(A_1\cup A_2 \cup \cdots)=P(A_1)+P(A_2)+\cdots$3)의 공리를 “가산가법성”이라고 부른다.

확률의 기본 성질

- 1) 각 사건 A에 대해 $0 \leq P(A) \leq1$이고 $P(\emptyset)=0$

2) $P(A^c) = 1-P(A)$

3) $A \subseteq B$이면 $P(A)\leq P(B)$

합사건의 확률

- 1) $P(A_1\cup A_2 \cup \cdots) = P(A_1) + P(A_2) + \cdots + P(A_n)$ $- P(A_1 \cap A_2) - P(A_1 \cap A_3) - \cdots - P(A_{n-1} \cap A_n)$ $+ \cdots + (-1)^{n-1}P(A_1\cap \cdots \cap A_n)$

2) $P(A_1 \cup A_2 \cup \cdots) \leq P(A_1) + P(A_2) + \cdots$2)의 성질을

가산반가법성이라고 부른다.

확률측도의 연속성

- 1) $A_1 \subseteq A_2 \subseteq \cdots$이면 $P(\bigcup_{n=1}^{\infty}A_n) = \lim_{n\to\infty}P(A_n)$

2) $B_1 \supseteq B_2 \supseteq \cdots$이면 $P(\bigcap_{n=1}^{\infty}B_n) = \lim_{n\to\infty}P(B_n)$

1.2. 조건부확률과 독립성

조건부확률

- 사건 A가 주어진 경우 사건 B의 조건부 확률은

$P(B|A) = \frac{P(A\cap B)}{P(A)} \;\;(P(A)>0)$

조건부확률은 사건 A가 주어짐에 따라 표본공간이 새롭게 바뀌는 것으로 생각해도 무방하다.

조건부확률의 성질

- 1) (곱셈공식) $P(A)>0, P(B)>0$일 때, $P(A\cap B) = P(A|B)\cdot P(B) = P(B|A)\cdot P(A)$

2) (전확률공식) 사건 $A_1, A_2, \cdots$이 표본공간의분할이면 $P(B) = \sum_{i=1}^{\infty} P(B|A_i)\cdot P(A_i)$분할 :

① $A_i\cap A_j = \emptyset \;(i\neq j)$

② $A_1\cup A_2 \cup \cdots = S$

베이즈 정리

- 사건 $A_i \; (i \in N)$이 표본공간의

분할이고 $P(A_i) > 0$일 때 $P(B)$이면 $P(A_j|B)\;\propto P(B|A_j)\cdot P(A_j)$증명은 분모에 전확률공식, 분자에 곱셈공식.

사건의 독립성

- 1) 두 사건이 독립 ($A \perp B$)

$P(A\cap B) = P(A)\cdot P(B) \iff P(A|B)= P(A)$

2) n개 사건이 독립

$P(A_i \cap A_j) = P(A_i)\cdot P(A_j) \; (1\leq i \ < j \leq n)$

$P(A_i \cap A_j \cap A_k) = P(A_i)\cdot P(A_j) \cdot P(A_k) \; (1\leq i \ < j < k \leq n)$

$\cdots$

$P(\bigcap_{i=1}^n A_i) = \prod_{i=1}^n P(A_i)$

1.3. 확률변수와 확률분포

확률변수

- 동전을 던진 횟수, 하천에 미생물이 분포한 정도 등의 값을 실수로 대응시켜 표본공간에서 정의되도록 하는 함수를 확률변수라고 한다.

$X(확률변수) : S \to R$

이산형/연속형 확률변수

- 이산형 확률변수 : 확률변수가 가질 수 있는 값의 집합이 ${x_1, x_2, \cdots}$와 같이 나타낼 수 있는 확률변수 (countable)

$f(x_i) = P(X = x_i) \; (i = 1, 2, \cdots)$을 확률질량/밀도함수 (probability mass/density function)라고 부른다. 이때 $\sum_x f(x) = 1$

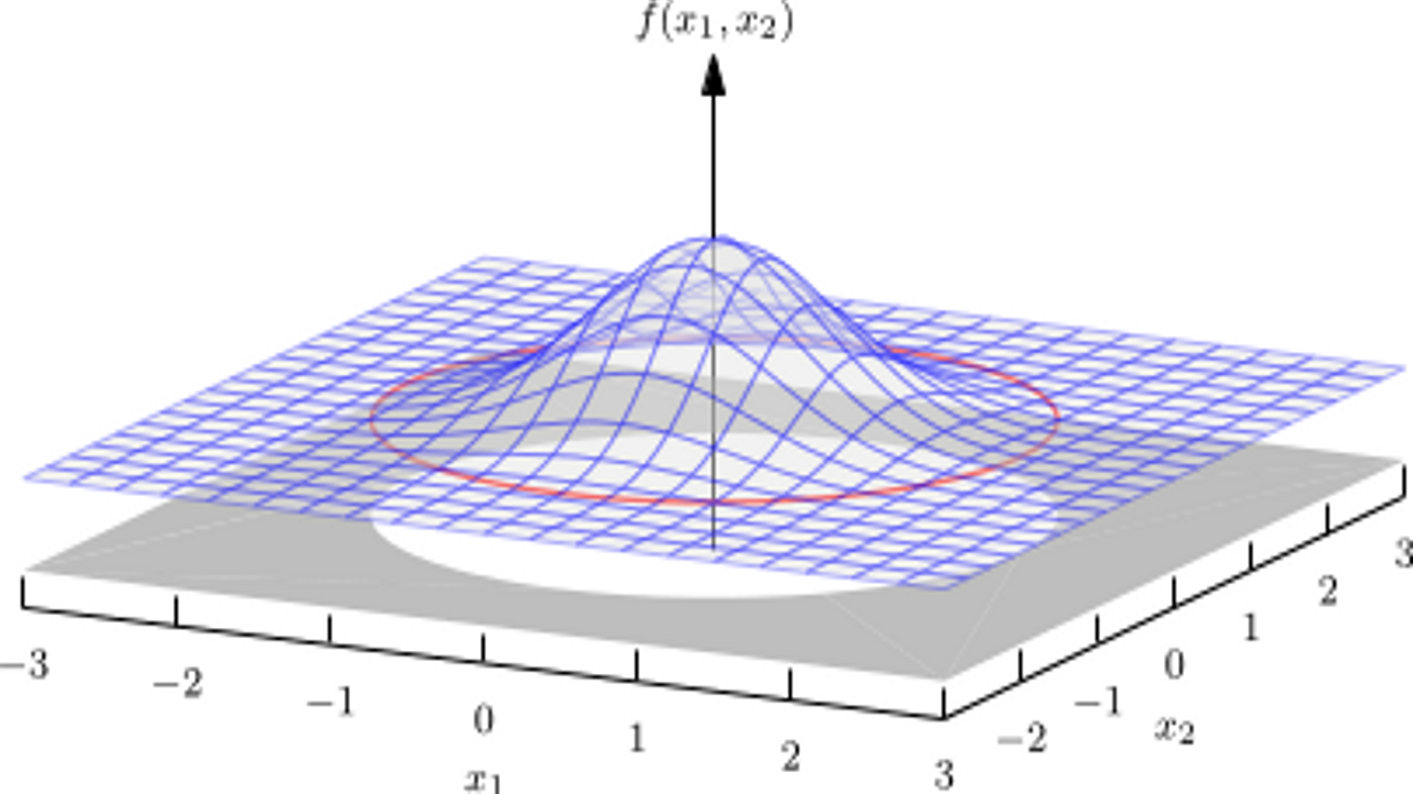

- 연속형 확률변수 : 확률변수가 실수 구간의 값을 가지고 확률이 적분으로 주어지는 경우

$P(a \leq X \leq b) = \int_a^b f(x) dx$을 확률밀도함수라고 부른다. 이때 $\int_x f(x)dx = 1$

확률분포

- 이산형/연속형 확률변수에서 확률질량/밀도함수는 $P(a \leq X \leq b)$를 정해주는데, 이를 X의 분포가 pdf에 의해 정해지는 X의 확률분포라고 정의한다. $(\iff X \sim pdf\;)$

확률분포의 정의는 여러 가지가 있을 수 있는데 뒤에 배울 cdf와 mgf 역시 확률분포라고 할 수 있다. 단, mgf는 특별한 조건이 더 필요하다.

평균과 기댓값

- 확률변수 X의 pdf가 f일 때, X의 평균은

$\mu = \sum_x xf(x) \;(이산형)$

$\mu = \int_{-\infty}^{+\infty} xf(x)dx \;(연속형)$

- 실함수 g(x)에 대해 g(X)의 기댓값은

$E[g(x)] = \sum_x g(x)f(x) \;(이산형)$

$E[g(x)] = \int_{-\infty}^{+\infty} g(x)f(x)dx \; (연속형)$

기댓값의 성질

① 선형성 : $E(aX+b) = aE(X) + b$ (a, b는 상수)

② 선형성 : $E[c_1g_1(X) + c_2g_2(X)] = c_1E[g_1(X)] + c_2E[g_2(X)]$

③ 단조성 : $g_1(x) \leq g_2(x)$이면 $E[g_1(X)] \leq E[g_2(X)]$

분산과 표준편차

- 확률변수 X의 pdf가 f이고 평균이 $\mu$일 때 X의 분산과 표준편차는

$Var(X) = E[(X-\mu)^2] = \sum_x (x-\mu)^2f(x)\; (이산형)$

$Var(X) = \int_{-\infty}^{+\infty} (x-\mu)^2f(x)dx \; (연속형)$

$sd(X) = \sqrt{Var(X)}$분산의 성질

① $Var(aX+b) = a^2Var(X)$ (a는 상수)

② $Var(X) = E(X^2) - [E(X)]^2$

확률변수의 표준화

- 평균이 $\mu$, 표준편차가 $\sigma$인 경우,

$Z = \frac{X-E(X)}{\sqrt{Var(X)}} = \frac{X-\mu}{\sigma}$

이때의 Z를 표준화된(standardized) 변수라고 부르며, 평균과 분산을 각각 0과 1로 만든다.

1.4. 누적분포함수와 적률생성함수

앞서 확률분포를 표현하는 방식으로 확률밀도함수(pdf)를 소개하였는데, 이제부터 소개할 누적분포함수(cdf)와 적률생성함수(mgf)도 확률분포를 표현할 수 있다.

누적분포함수

- 이산형 cdf : $F_X(x) = P(X \leq x) = \sum_{t:t \leq x} f_X(t)$

특히 $x_1 < x_2 < \cdots$인 순서통계량이면 $f_X(x_k) = F_X(x_k) - F_X(x_{k-1}$)

- 연속형 cdf : $F_X(x) = P(X \leq x) = \int_\infty^x f_X(t)dt$

특히 f가 연속인 x에 대해 $\frac{d}{dx}F_X(x) = f_X(x)$

(미적분학의 기본정리) - 누적분포함수의 성질

– ① (증가성) $x_1 < x_2$이면 $F_X(x_1) \leq F_X(x_2)$

– ② (전체변동) $\lim_{x\to -\infty} F_X(x) = 0,\; \lim_{x\to \infty} F_X(x) = 1$

– ③ (우측 연속) $\lim_{h \to 0}F_X(x+h) = F_X(x)\;\;(h>0)$연속형 확률변수인 경우 좌측 연속도 성립할 수 있으나 이산형인 경우 다를 수 있다.

확률생성함수

- 음이 아닌 정수 값을 갖는 확률변수 X의 확률생성함수는

$G(s) = E(S^X) = \sum_{x=0}^\infty s^x \cdot P(X=x) \; (-1 < s < 1)$ 이때 X의 pdf는 $f_X(k) = P(X=k) = G^{(k)}(0)/k!, \; k = 0, 1, 2, \cdots$확률생성함수와 확률밀도함수는 사실상 동치관계!

적률생성함수

- 0을 포함하는 열린구간 내의 t에 대해 $M_X(t) = E(e^{tX})$ ($\;\exists \;h>0 \; s.t. \; -h< t < h$)을 확률변수 X의 적률생성함수(moment generating function)라고 한다.

적률의 정의 : $E(|X|^k) < \infty$일 때

$m_k = E(X^k)$를 확률변수 X의 k차 적률이라고 한다. - 적률생성함수의 성질

– ① $M_X(t)= E(e^{tX}) < \infty$ 이면 X의 모든 적률이 존재하고, $E(X^k) = M^{(k)}(0) = m_k, \;\; M_X(t) = \sum_{k=0}^\infty \frac{E(X^k)}{k!}t^k, \;\; k \in N$

– ②분포결정성: $M_X(t) = M_Y(t)$가 0을 포함하는 열린구간에서 성립하면 X와 Y의 확률분포가 일치한다. (pdf, cdf가 일치)

누율생성함수

- 적률생성함수에 로그를 취한 $C_X(t) = logM_X(t) = \sum_{r=0}^{\infty} \frac{C^{(r)}(0)}{r!}t^r$를 확률변수 X의 누율생성함수(cumulant generating function)라고 한다. 이때의 $C^{(r)}(0) = c_r$를 X의 r차 누율이라고 한다.

$c_1 = m_1=E(X), \;\; c_2 = m_2-(m_1)^2 = Var(X)$

왜도(skewness)와 첨예도(kurtosis)

- 왜도는 분포의 비대칭도를, 첨예도는 분포가 얼만큼 중심에 몰려있는가를 나타내는 척도이다.

- 왜도 : $c_3(Z) = m_3(Z) = E[(\frac{X-\mu}{\sigma})^3]$

- 첨예도 : $c_4(Z) = m_4(Z)-3 = E[(\frac{X-\mu}{\sigma})^4]-3$

왜도와 첨예도 실제 계산에 있어 표준화가 복잡하기 때문에 다음과 같은 공식을 사용한다. $c_r(Z) = c_r(\frac{X-\mu}{\sigma}) = \frac{c_r(X)}{\sigma^r}$

※부록 : 여러가지 부등식

Jensen’s Inequality

- 수직선 위의 구간 I에서 확률변수 X의 기댓값이 존재하면

아래로 볼록한 함수 $\phi$에 대해 $\phi [E(X)] \leq E[\phi(X)]$위 부등식으로 분산이 항상 0 이상임을 보일 수 있다. ($x^2$가 아래로 볼록 이용)

Lyapounov’s Inequality

- 확률변수 X에 대해 $E[|X|^s] < \infty$이면 $0 < r < s$인 $r$에 대해

$(E[|X|^r])^{1/r} \leq (E[|X|^s])^{1/s}$

Markov’s Inequality

- $E[|X|^r] < \infty$이면 $\forall k>0$에 대해

$P(|Z| \geq k)\leq E(|Z|^r)/k^r$

Chebyshev’s Inequality

- 확률변수 X에 대해 $Var(X) < \infty$이면 $\forall k>0$에 대해

$P(|X-E(X)| \geq k) \leq Var(X)/k^2$분산 0의 의미 : Chebyshev’s Inequality를 적용하면 확률변수 X의 평균이 $\mu$이고 $Var(X) < \infty$이면 $P(X=\mu) = 1$

(참고문헌)

- 김우철, 『수리통계학』, 민영사

- Hogg, 『Probability and Statistical Inference』, Pearson

- Wikipedia

Comments